FOV, IPD, TTL, ASW, sono tutti acronimi che prima o poi chi bazzica in realtà virtuale sentirà nominare. Se per te VR sta ad indicare ancora le iniziali di Valentino Rossi, ti consiglio prima di recuperare la nostra guida per principianti. Se invece hai già acquistato il tuo primo visore e hai provato le prime esperienze, fermati a leggere queste nozioni, così anche tu potrai fare la figura di “quello che ne sa” nel nostro canale Discord.

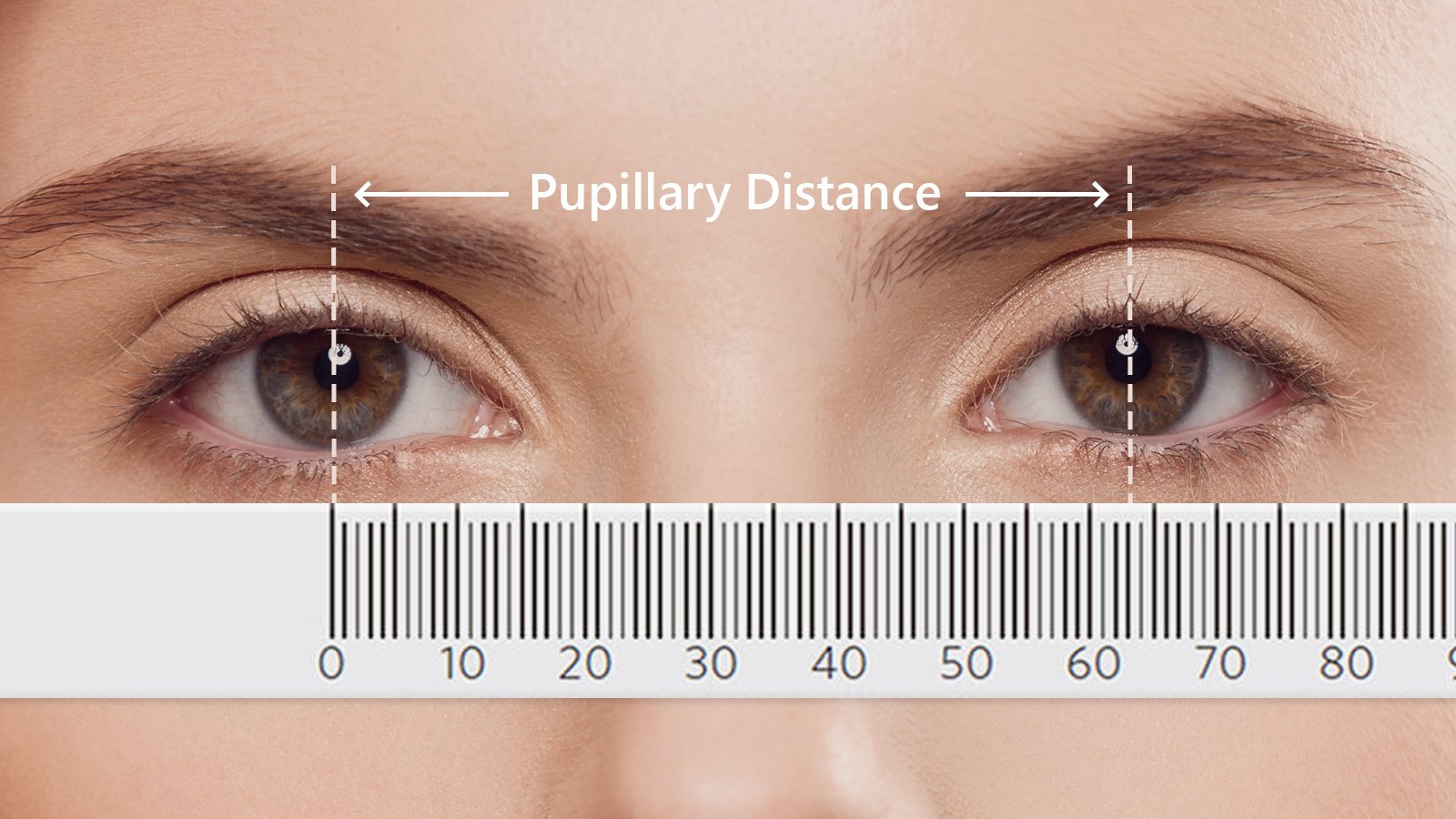

IPD (Inter Pupillary Distance, in italiano distanza tra le pupille)

Ne avevamo già parlato nella nostra guida per principianti poiché l’IPD è una caratteristica fondamentale da valutare ancor prima dell’acquisto di un visore. L’IPD non è nient’altro che la distanza tra le nostre pupille misurata in millimetri. Si può conoscere con esattezza recandosi in un centro ottico, ma per la scelta del visore basta misurarsela da soli con un righello davanti allo specchio. La regolazione dell’IPD non è uguale per tutti i visori, per alcuni è hardware mentre per altri è solo software, quindi occorre verificare il range coperto. Se il nostro IPD è fuori da questo range, potremmo affaticare troppo la nostra vista, rendendo di fatto il tutto inutilizzabile.

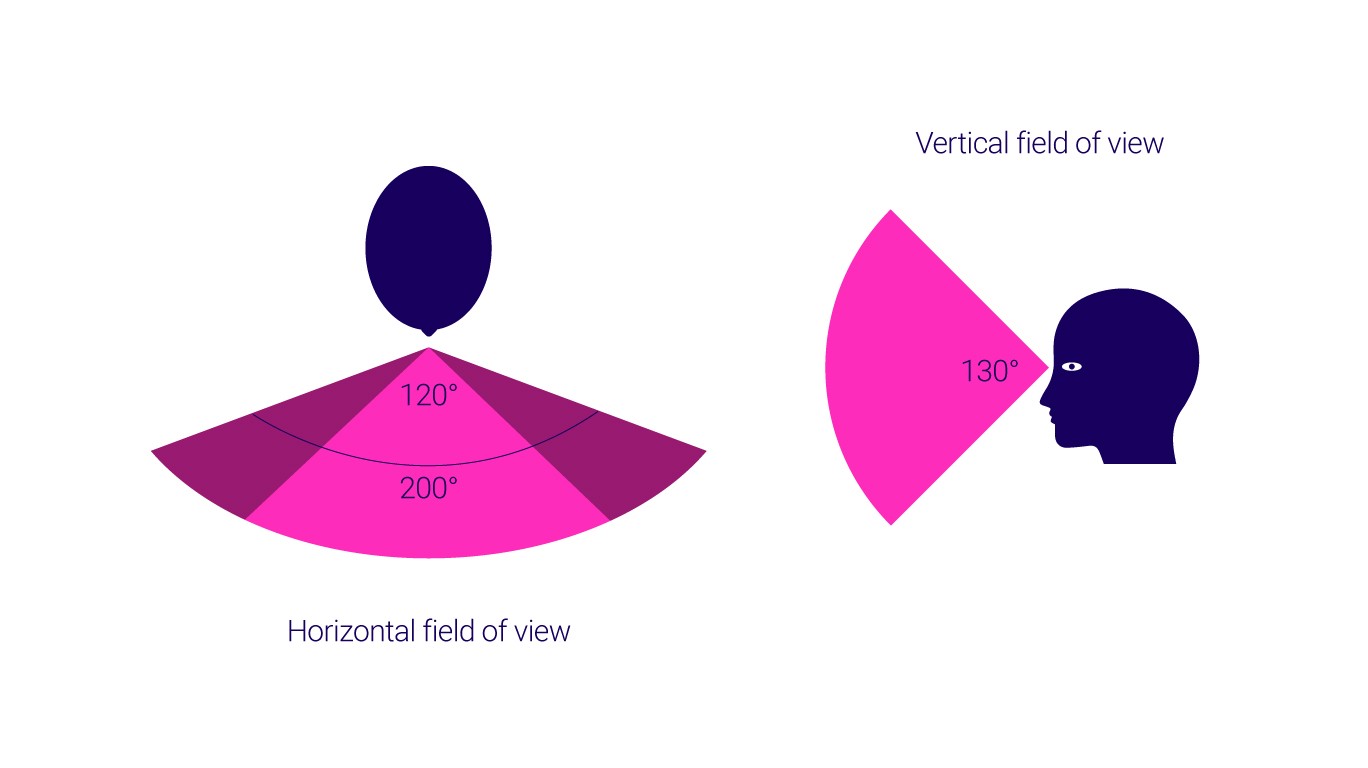

FOV (Field Of View, in italiano campo visivo)

Il FOV non è nient’altro che il campo visivo che vedremo una volta indossato il nostro caschetto. La maggior parte dei visori in commercio hanno un FOV compreso tra i 90° e i 100°, quindi una volta indossati sarà normale notare quello che viene chiamato “effetto maschera da sub”. Infatti il FOV orizzontale della vista umana è di circa 200°, quindi con qualsiasi valore inferiore visualizzeremo delle bande laterali nere ai lati mentre siamo in VR. Alcune aziende (in particolare Pimax) propongono visori con FOV elevato per ovviare a questo problema, ma ciò comporta avere lenti e display grandi, oltre che correzioni a livello software per evitare distorsioni. I Pimax per questo motivo non sono visori adatti a tutte le tasche.

Sweet spot

Un altro fattore legato alle lenti è lo sweet spot, e cioè quell’area al centro delle lenti che ci permette di vedere a fuoco in VR. I visori, a causa della forma e della tecnologia utilizzata, possono avere uno sweet spot più o meno grande. In ogni caso più è piccolo lo sweet spot più dovremo posizionare il nostro visore con precisione in testa per vedere a fuoco (riposizionandolo ovviamente più spesso se si muove). Inoltre a causa dello sweet spot limitato è normale nei visori odierni vedere più sfuocato se si osserva con le pupille verso i bordi delle lenti.

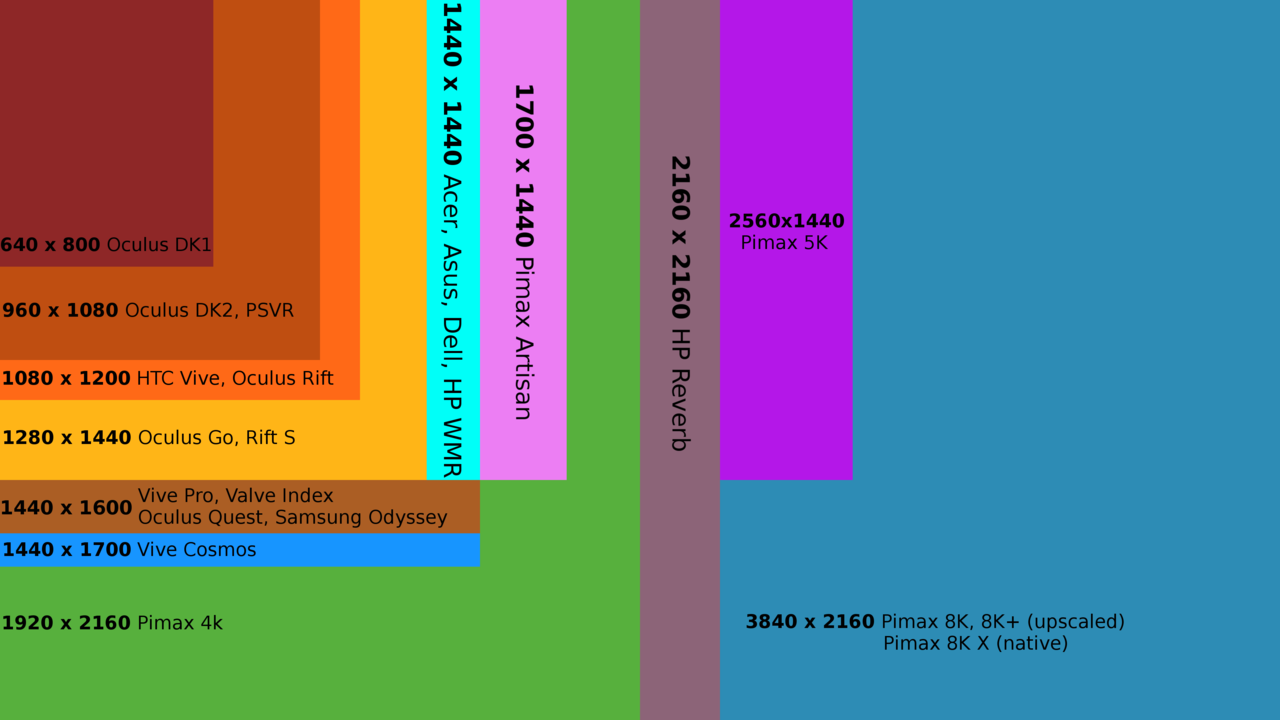

Risoluzione per occhio e PPD (Pixel Per Degree)

Non tutti forse sanno che i visori VR possono utilizzare due diverse configurazioni per quanto riguarda i display. Alcuni utilizzano un singolo pannello sul quale vengono visualizzate due immagini (una per occhio). Le lenti sono separate fisicamente dal display, e ciò non permette una regolazione dell’IPD molto precisa. Altri visori invece utilizzano due pannelli separati che sono montati in maniera solidale alle lenti. In questo modo è possibile regolare l’IPD via hardware (con un cursore) in maniera molto più precisa. Perciò in VR usualmente quando si parla di risoluzione si preferisce indicare quella per ciascun occhio invece che quella totale. La risoluzione però non ci dice tutto: i display dei visori infatti possono essere più o meno grandi e montati più o meno vicini ai nostri occhi. Per questo diventa importante il concetto di PPD (ovvero Pixel Per Degree), ovvero quanti pixel possono essere visualizzati per ogni grado del nostro campo visivo: maggiore è la densità di pixel per grado, più nitida sarà la nostra visuale in VR. Se ti interessa approfondire l’argomento ti rimando alla lettura di questo articolo.

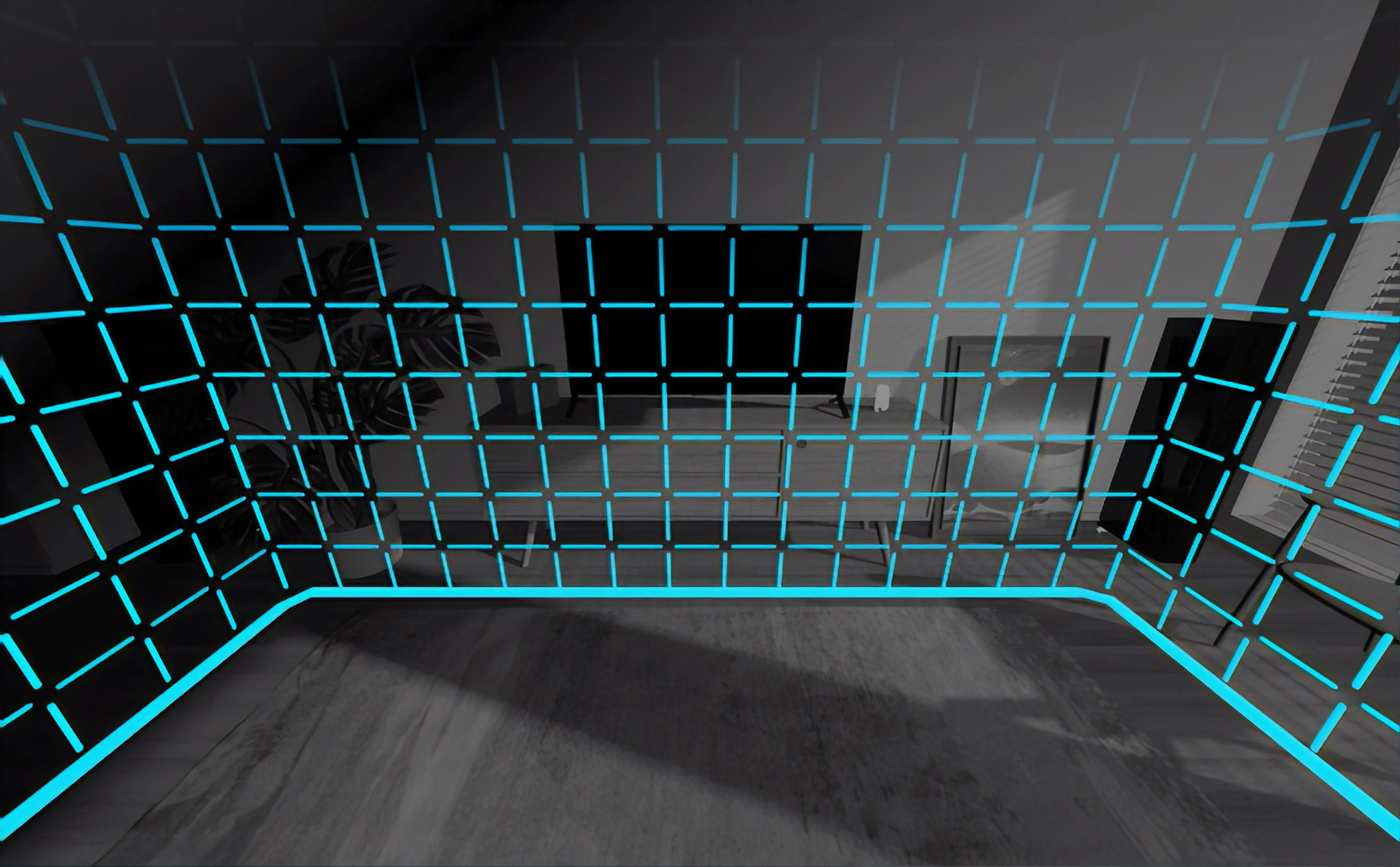

SDE (Screen Door Effect, in italiano effetto zanzariera)

I display dei visori, pur essendo a risoluzioni elevate, sono montati a pochi centimetri dai nostri occhi. Per questo motivo quando osserviamo le ambientazioni all’interno dei nostri caschetti noteremo una griglia nera più o meno presente, soprattutto se osserviamo uno sfondo molto chiaro. Quella “zanzariera” non è nient’altro che il reticolo formato dallo spazio nero che c’è tra i vari pixel. Per eliminarlo si può fare ben poco: alcuni visori (come il Samsung Odissey) propongono un filtro anti-SDE che però aumenta leggermente il blur. La soluzione definitiva è attendere che la risoluzione dei visori sia così alta da rendere invisibile questo effetto (per dettagli ulteriori ti rimando sempre a questo articolo).

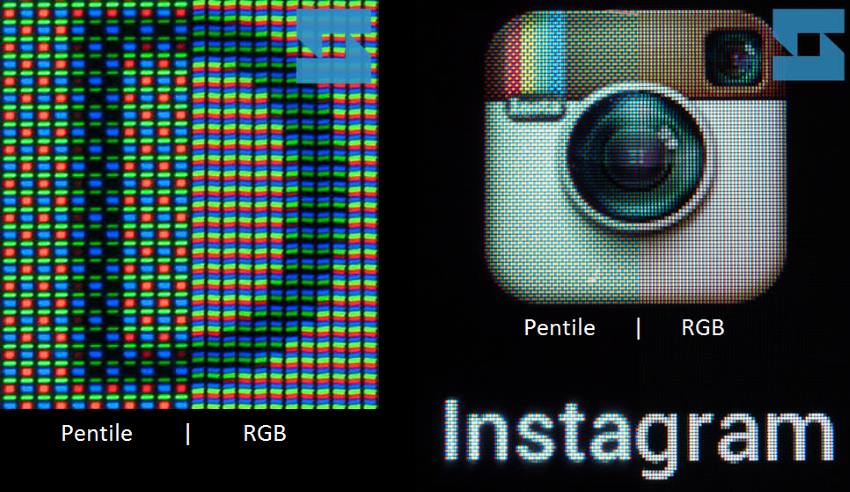

Pixels, Sub-Pixels, Pentile, RGB, insomma: OLED vs LCD

I display più utilizzati negli attuali visori sono essenzialmente di due tipi: LCD con distribuzione RGB e OLED con distribuzione Pentile. Nella matrice RGB abbiamo 3 subpixel (rosso, verde,blu) per ogni pixel, mentre nella matrice OLED ne abbiamo solo due (un subpixel verde dedicato + mezzo pixel rosso e mezzo blu, con l’altra metà condivisa con il pixel vicino). Per questo motivo anche la distribuzione dei subpixel contribuisce all’SDE: a parità di risoluzione, si vedrà più effetto zanzariera su un display con matrice Pentile rispetto ad un altro con matrice RGB. Gli LCD a matrice RGB quindi sembrano i più indicati per i visori VR, ed in effetti Oculus, Valve ed HP hanno adottato ormai tutti questa tecnologia nei loro ultimi modelli. Gli OLED mantengono però dei vantaggi evidenti rispetto agli LCD, vista la loro capacità di rappresentare neri assoluti (e quindi contrasti infiniti). Inoltre molti concordano che un display OLED, se correttamente tarato, riesca a mostrare immagini dai colori più vivi e meno “slavati”. Quindi perché non utilizzare dei display OLED RGB? Il motivo fondamentale è contenere i costi, visto che questo tipo di display non è economico da produrre, e i visori VR sono ancora poco diffusi. Inoltre la resa produttiva e la difficoltà nel reperire micro-display ad elevata risoluzione in quantità industriali ha portato i maggiori produttori ad orientarsi verso l’LCD. Solo Sony nel suo PSVR è riuscita a proporre un OLED RGB mantenendo bassi i costi, speriamo continui a seguire questa strada anche per il suo prossimo visore.

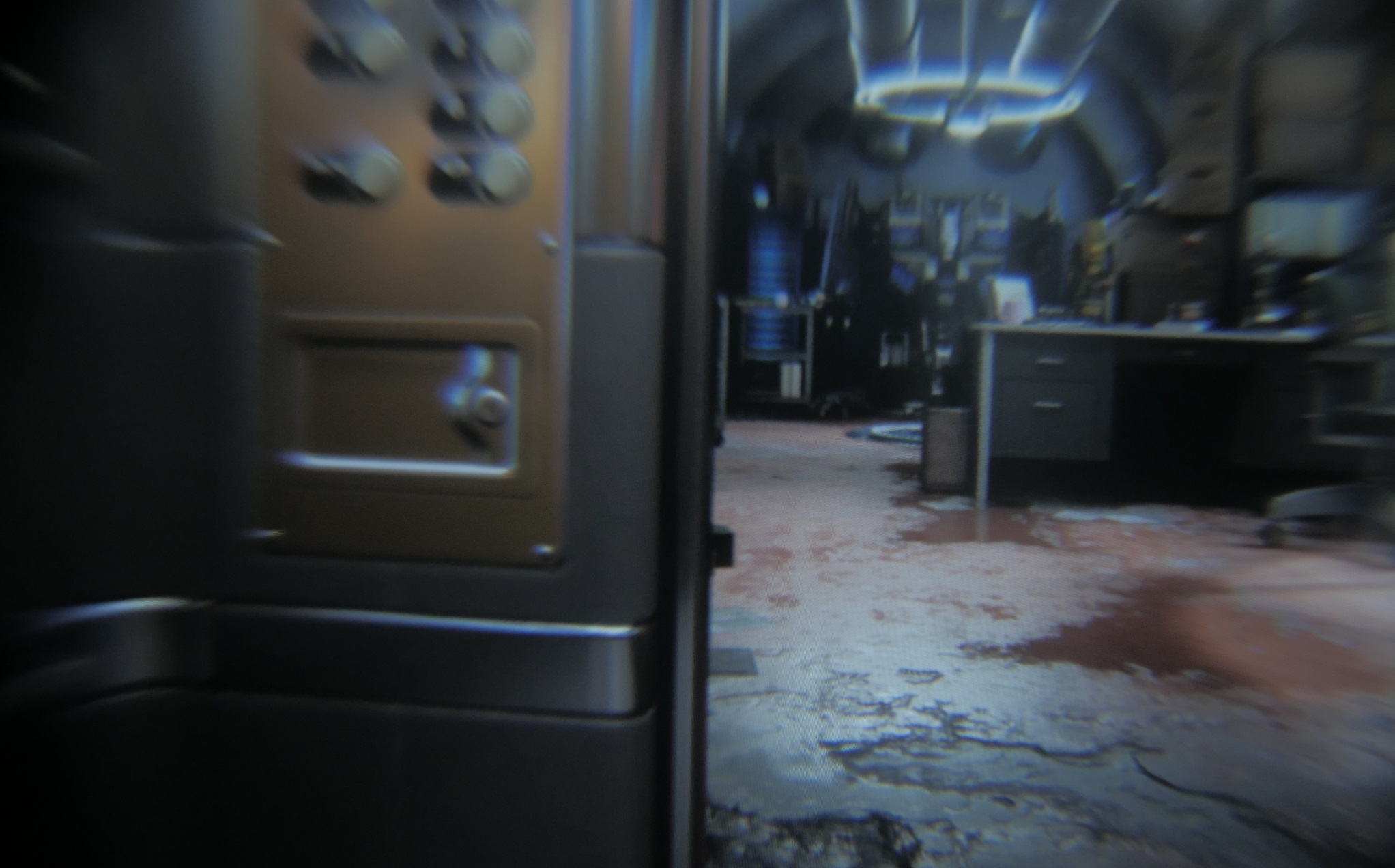

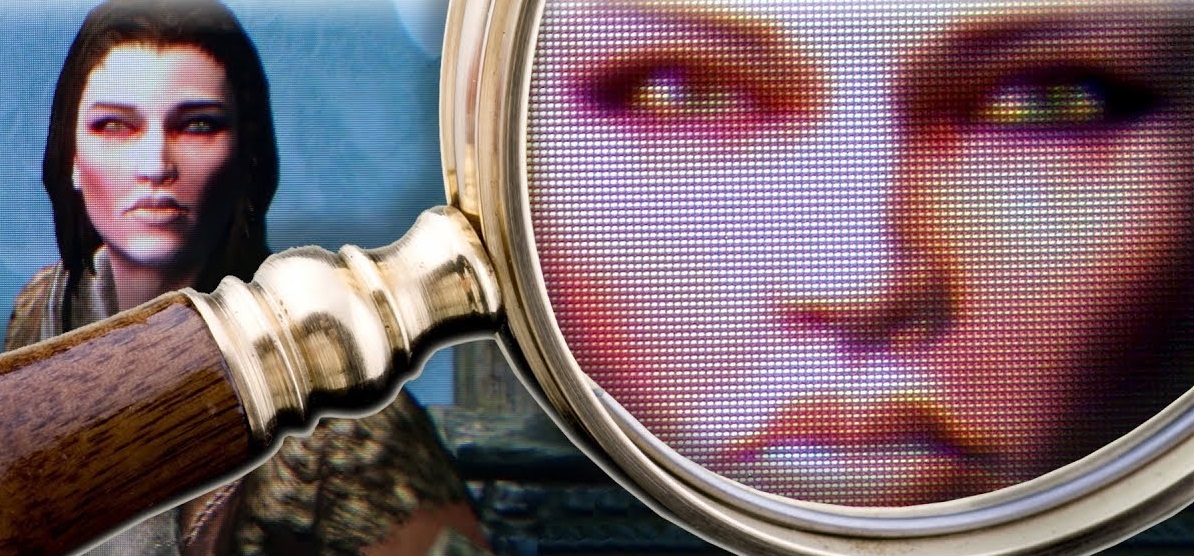

TTL (Through The Lenses)

Con questo termine si intende quella tecnica che permette di effettuare foto e video attraverso le lenti di un visore. L’immagine mirror che vediamo sul monitor quando giochiamo in VR infatti non fornisce assolutamente l’idea di come appare in realtà all’interno del nostro caschetto. Questo aspetto è impossibile da realizzare (ed è uno dei più grandi limiti che la VR ha per imporsi al pubblico) però almeno i TTL servono per fare una comparazione più realistica. Questa tecnica consiste nel registrare attraverso le lenti del visore con una macchina fotografica dotata di obiettivi adatti allo scopo. Sebbene nessuna fotocamera può rappresentare ciò che vedono i nostri occhi, oltre alla mancanza della stereoscopia, i TTL aiutano a rendersi conto in particolare delle differenze di SDE e risoluzione tra i vari visori. Resa dei colori, livelli di contrasto, luminosità e tutto il resto che compone i quadro visivo finale possono essere valutati solo indossando personalmente il caschetto.

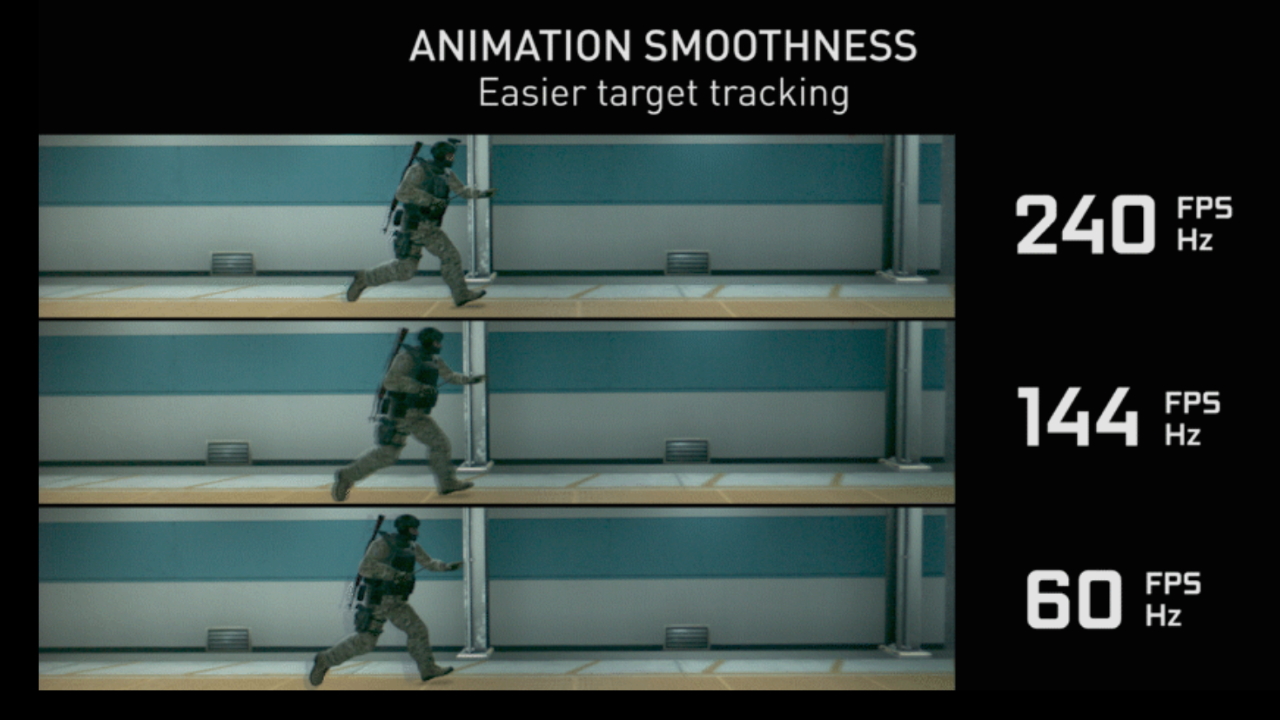

Refresh Rate (Frequenza di aggiornamento)

Il refresh rate dei display dei visori ha lo stesso significato di quello dei normali display: indica la frequenza di aggiornamento dei pixel. In VR però è fondamentale garantire un refresh elevato e costante, per non andare incontro a motion sickness. Il valore di riferimento per i visori consumer è sempre stato 90Hz, anche se comunque refresh inferiori (come i 72Hz del Quest) non sembrano causare grossi problemi, a meno di non essere particolarmente sensibili.

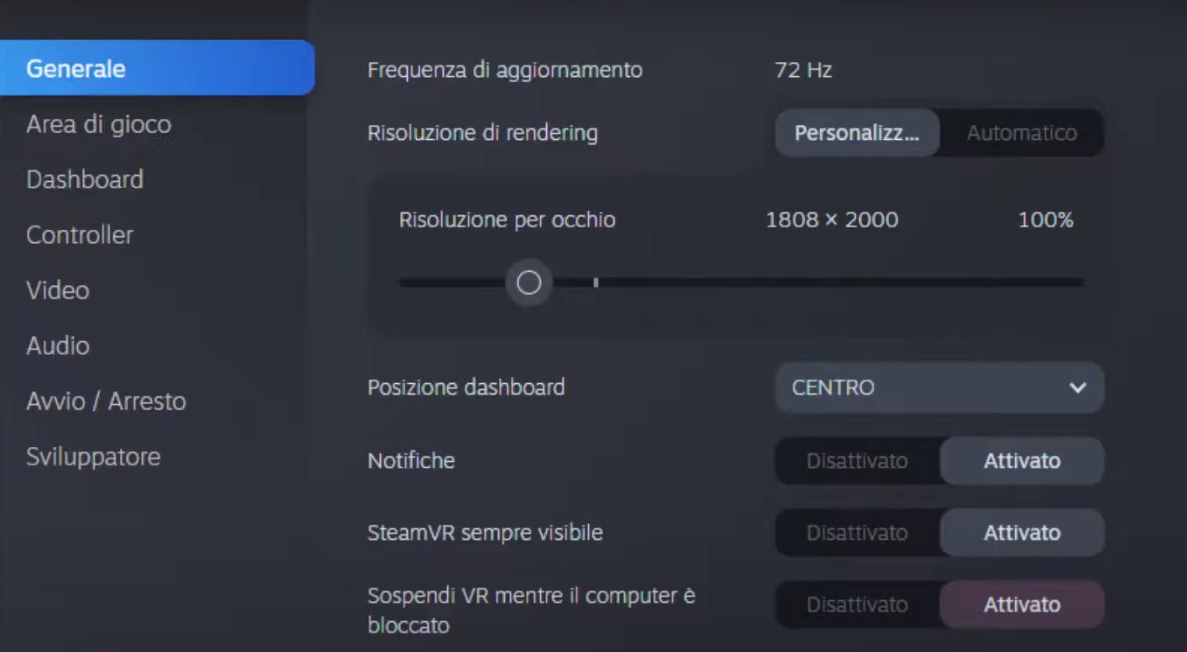

Super-sampling (SS)

La densità di pixel ancora relativamente bassa dei visori VR attuali comporta che l’immagine finale risulta poco nitida e con un aliasing evidente. Le normali tecniche di anti-aliasing usate nei giochi tradizionali spesso fanno peggio, aumentando tantissimo la sfocatura (soprattutto il TAA), oppure sono inefficaci nell’eliminare lo shimmering (come l’FXAA). Per migliorare la resa finale in VR quindi si preferisce agire su quello che viene definito super-sampling, cioè si aumenta la densità di pixel oltre al render target del visore per ottenere maggiore pulizia grafica. Ovviamente non bisogna esagerare, il SS impatta in maniera evidente sulle prestazioni. Sebbene con tecniche differenti, sia i tool di Oculus che di Steam permettono di effettuare in maniera semplice questa operazione. Anzi se non tocchiamo nessuna impostazione SteamVR adatta in maniera automatica il super-sampling all’hardware che possediamo, garantendoci sempre la massima qualità visiva possibile senza che venga compromessa la fluidità.

Render Target

La risoluzione che un visore VR deve renderizzare (il Render Target) è sempre superiore a quella effettiva del display. Al contrario dei monitor tradizionali infatti i visori devono deformare l’immagine prima che venga mostrata sui pannelli, e questa trasformazione richiede più pixel per non perdere in precisione. Possiamo dire che funziona come un super-sampling, tranne per il fatto che deve compensare la distorsione a cuscinetto delle lenti aggiungendo una distorsione a barilotto all’immagine, quindi non c’è un ridimensionamento lineare. Inoltre nel caso sia presente un solo display (come nel Quest 2) per permettere la regolazione dell’IPD, il visore deve riservare uno spazio sufficiente su entrambe le estremità del pannello per consentire il riposizionamento delle immagini. Possiamo conoscere il Render Target del nostro visore nelle impostazioni di SteamVR mettendo il super-sampling al 100%. Se possediamo un visore che utilizza altri software oltre a SteamVR (come i visori Oculus) dobbiamo accertarci che anche qui non sia stato applicato il super-sampling.

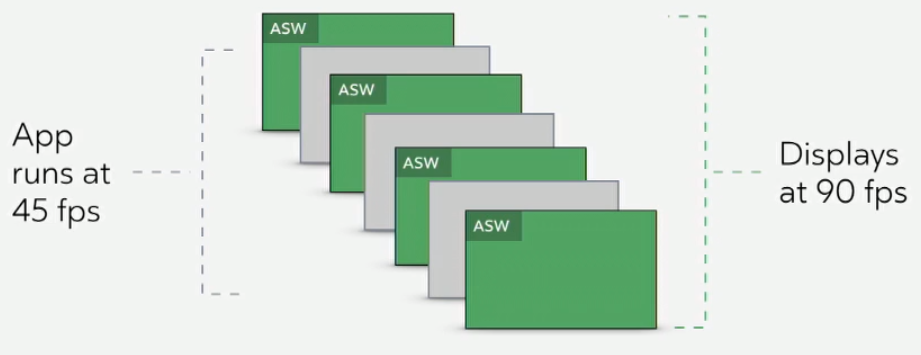

Tecniche di riproiezione (Reprojection, ASW, etc.)

Renderizzare scene ad alta risoluzione e ad elevati fps ha un impatto notevole sull’hadware. Inoltre spesso i giochi non sono ottimizzati per garantire sempre una fluidità costante, in particolare gli open world più complessi. Fortunatamente in VR ci vengono incontro le tecniche di riproiezione, che permettono di abbassare la latenza e migliorare la fluidità, tutto a vantaggio del nostro benessere fisico. Le tecniche di riproiezione si dividono essenzialmente i due: quelle che influiscono sulla rotazione della testa (e sono sempre attive) e quelle che agiscono sui movimenti nello spazio del nostro alter-ego e degli elementi che ci circondano (che si attivano al bisogno). Se vuoi approfondire l’argomento, ti invito a recuperare questo articolo.

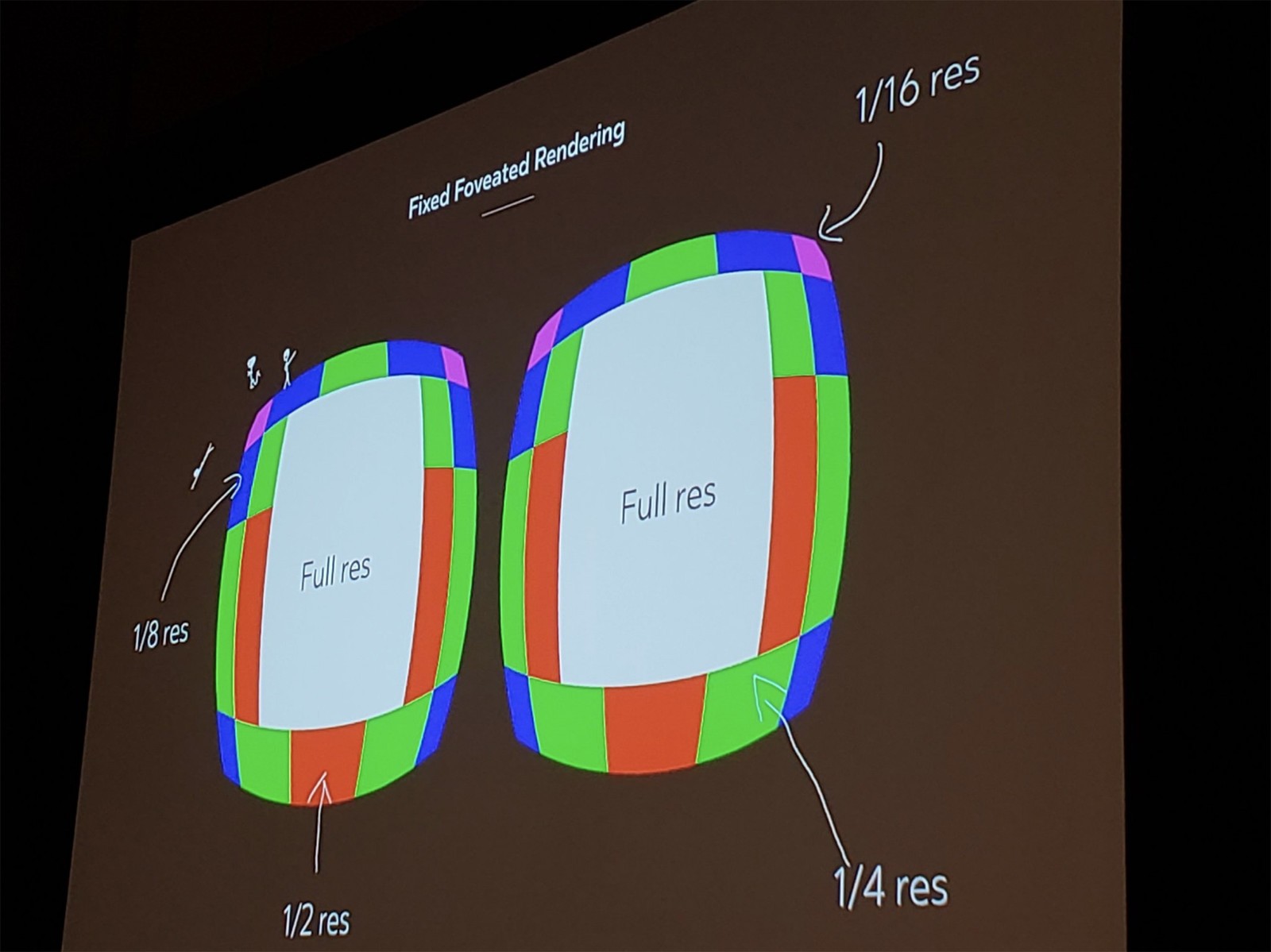

Foveated Rendering ed Eye Tracking

La fovea è quella parte dell’occhio dove si concentra la massima acutezza visiva. E’ l’unica area quindi in grado di apprezzare i dettagli dell’alta risoluzione, ma è grande solo 0,5 mm e copre 1,5° del nostro campo visivo. Questa caratteristica tipica della nostra vista ha indotto lo sviluppo della tecnica del Foveated Rendering. Quando applicato, il Foveated Rendering riduce la densità di pixel man mano che ci si allontana dalla zona centrale, quella che mettiamo maggiormente a fuoco. Questo permette di snellire il carico computazionale, però se usato in maniera troppo aggressiva può portare ad un degrado sensibile dell’immagine. Il Foveated Rendering può essere fisso o dinamico (in questo caso la riduzione della densità dei pixel varia a seconda del carico computazionale). Questa tecnica accoppiata con l’Eye Tracking può sulla carta alleggerire tantissimo lo sforzo dell’hardware. Un produttore che propone già concretamente questa implementazione è Pimax: il suo modulo per l’Eye Tracking infatti sfrutta la tecnologia del Variable Rate Shading (VRS) di Nvidia per utilizzare il Foveated Rendering dinamico (DFR) in base al nostro punto focale. Per maggiori informazioni recupera questo articolo.

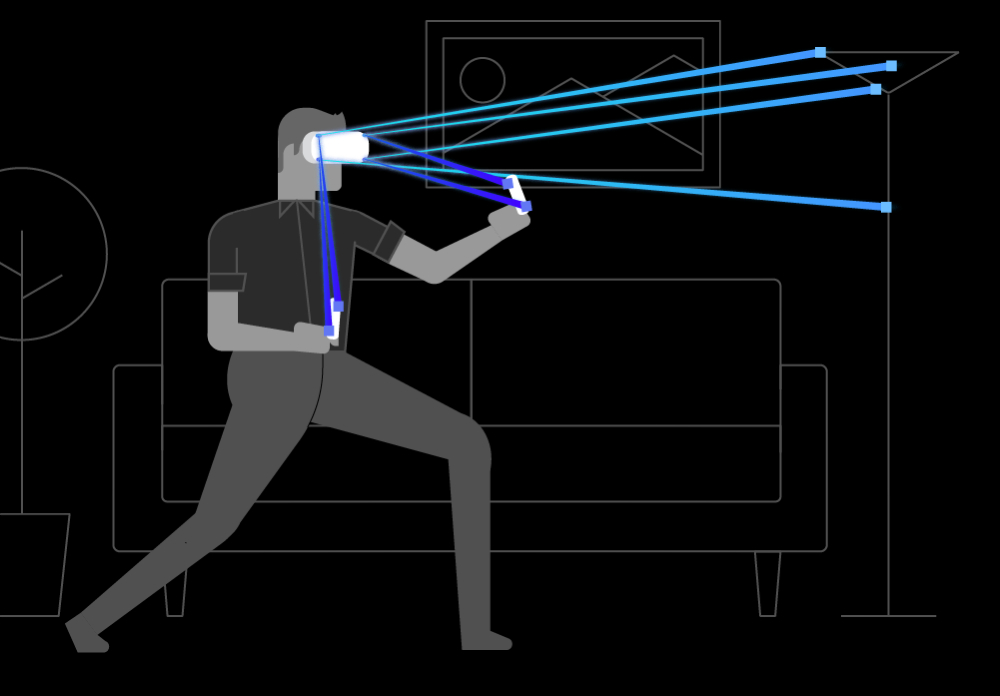

Inside-Out Tracking

Inside-out Tracking significa che il tracciamento della testa e dei controller viene eseguito da due o più telecamere poste direttamente nel visore. Questa tecnica, adottata per la prima volta nei visori Windows Mixed Reality, permette di muoversi ed interagire in un ambiente virtuale senza installare sensori esterni. Il metodo di tracking alternativo viene chiamato Outside-In, quando appunto si utilizzano sensori esterni, come le Base Stations del Vive e dell’Index. Alla ovvia praticità fa da contraltare il fatto che ci saranno sempre delle zone d’ombra nelle quali i controller non possono essere tracciati perché escono dal campo visivo delle telecamere (per esempio dietro la schiena).

Hand Tracking

Quando si parla di Hand Tracking si fa sempre riferimento alla capacità di un visore di mappare la forma e i movimenti delle nostre mani attraverso delle telecamere per poi riproporli in realtà virtuale. Oculus Quest ha già da mesi implementato questa tecnica, e anche Pimax la supporta acquistando un modulo aggiuntivo. La comodità di utilizzare le proprie mani in realtà virtuale è sicuramente notevole in determinate applicazioni, ovviamente non si può raggiungere la precisione dei controller di movimento, per il momento.

Passthrough

Con questo termine si indica la capacità di un visore di visualizzare l’ambiente in cui ci troviamo direttamente nel display. Le telecamere utilizzate per il tracking vengono sfruttate per registrare in tempo reale ciò che ci circonda: in questo modo possiamo interagire con il mondo reale senza togliere il visore. Usualmente i visori con Inside-Out Tracking integrano tutti questa funzione, che si attiva manualmente o quando usciamo dalla nostra area di gioco.

Parametri dello streaming: Bitrate ed Encoding resolution

Oculus Quest (1 & 2) può connettersi tramite la funzione Oculus Link oppure wireless con Virtual Desktop per sfruttare la propria libreria di giochi su PC. Il flusso video dal PC al visore non è nativo, non essendoci una connessione HDMI o Display Port, ma viene trasmesso in streaming. Ecco perché oltre al supersampling e alle usuali impostazioni grafiche entrano in gioco altri due fattori molto importanti per la resa finale dell’immagine nel visore, ovvero il Bitrate e la risoluzione dell’encoder (Encoding resolution). Il Bitrate misura la quantità di dati inviati al visore al secondo (larghezza di banda), e si indica in megabit al secondo (Mbps). Il Bitrate per Oculus Link può essere impostato attraverso l’Oculus Debug Tool, mentre con Virtual Desktop direttamente nelle impostazioni per lo streaming VR nell’app. Più si aumenta il Bitrate più diminuisce la compressione ma al contempo aumenta la latenza. L’Encoding resolution invece è un parametro che si può modificare solo per la funzione Oculus Link (per il momento). Esso indica la risoluzione del flusso video compresso inviato al visore, ed è importante che il suo valore si avvicini alla risoluzione nativa del display (hardware permettendo) per evitare un degrado dell’immagine. Se vuoi approfondire queste due funzioni per Oculus Link recupera questo articolo.

Per qualsiasi dubbio o curiosità scrivi pure nei commenti, soprattutto se mi è sfuggito qualche altro termine tecnico del quale vuoi conoscere il significato!

Ringrazio Massimo Morselli per avermi aiutato con la revisione finale.

Iscrivetevi al nostro canale Discord per restare sempre aggiornati sulle ultime novità e stare in compagni di appassionati come voi!

Link: Gruppo VR-ITALIA